图片来源:路透社

关注人工智能伦理的科学家指出了与该技术相关的风险

突出了- 新的人工智能助手有望完成更复杂的任务Nal和工作任务

- 今天早期的药剂仅仅是一种证明型

- 大多数人工智能副驾驶都是由GPT-4这样的模型驱动的

在Siri和Alexa等虚拟助手出现大约十年后,由ChatGPT及其竞争对手背后的最新版本技术驱动的新一波具有更大自主权的人工智能助手正在加大赌注。

运行在GPT-4或类似模型上的实验系统正在吸引数十亿美元的投资,硅谷正在竞相利用人工智能的进步。这些新助手——通常被称为“代理人”或“副驾驶员”——承诺在人类命令下执行更复杂的个人和工作任务,而无需密切监督。

开发人员迪夫·加格(Div Garg)说:“从高层次上讲,我们希望它成为你的私人人工智能朋友。”他的公司MultiOn正在对一款人工智能代理进行beta测试。

“它可能会演变成贾维斯(Jarvis),我们希望它与你的许多服务相连,”他补充说,他指的是托尼·斯塔克(Tony Stark)在《钢铁侠》(Iron Man)系列电影中不可或缺的人工智能。“如果你想做某事,你就去和你的人工智能说话,它就会为你做事。”

这个行业离模仿科幻小说中令人眼花缭乱的数字助理还很远;例如,加格的代理人可以在DoorDash上浏览网页点汉堡,而其他人可以制定投资策略,给Craigslist上卖冰箱的人发电子邮件,或者为迟到的人总结工作会议。

“很多对人来说很容易的事情对计算机来说仍然很难,”通用智能(general Intelligent)的首席执行官仇kanjun说。通用智能是OpenAI的竞争对手,为代理开发人工智能。

“比如说你的老板需要你安排一次与一群重要客户的会议。这涉及到对人工智能来说很复杂的推理技能——它需要了解每个人的偏好,解决冲突,同时在与客户合作时保持谨慎的接触。”

路透社对20多位企业家、投资者和人工智能专家的采访显示,随着人工智能行业向在无数认知任务中与人类相当或超越人类的通用人工智能(AGI)迈进,未来几年,越来越先进和自主的人工智能可能会带来越来越复杂的技术,早期的努力只是其中的一小部分。

这项新技术引发了一股由GPT-4等所谓基础模型驱动的助手热潮,席卷了个人开发者、微软(Microsoft)和谷歌母公司Alphabet等大公司,以及许多初创公司。

仅举一家初创公司Inflection AI为例,该公司在6月底筹集了13亿美元(约合1066.3亿卢比)。该公司联合创始人里德•霍夫曼和穆斯塔法•苏莱曼在播客中表示,该公司正在开发一款个人助理,据称可以充当导师,或处理诸如在旅行延误后获得机票积分和预订酒店等任务。

人工智能初创公司Adept已经筹集了4.15亿美元(约合3404亿卢比),它吹嘘自己的商业利益;在网上发布的一个演示中,它展示了你如何用一句话提示它的技术,然后看着它自己导航一家公司的Salesforce客户关系数据库,完成一个任务,它说这个任务需要人类点击10次或更多。

Alphabet拒绝就人工智能相关工作发表评论,而微软表示,其愿景是让人类控制人工智能副驾驶,而不是自动驾驶。

第一步:摧毁人性

邱和其他四位代理开发人员表示,他们预计第一批能够可靠地执行多步骤任务并具有一定自主性的系统将在一年内上市,专注于编码和营销任务等狭窄领域。

“真正的挑战是建立具有强大推理能力的系统,”邱说。

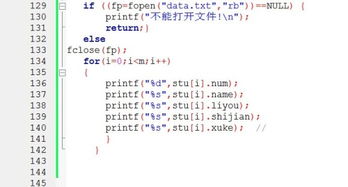

开发人员OpenAI在3月份发布了GPT-4,这是ChatGPT(去年11月发布时引起轰动的聊天机器人)背后模型的强大升级版。

专注于人工智能代理的风险投资公司CRV的投资者Vivian Cheng表示,GPT-4促进了在不可预测的现实世界中导航所需的战略和适应性思维。

能够相对复杂推理的代理的早期演示来自于三月份创建了BabyAGI和AutoGPT开源项目的个人开发人员,它们可以根据预先定义的目标和先前操作的结果确定优先级并执行任务,例如销售前景和订购披萨。

据接受采访的8位开发者表示,目前的早期代理仅仅是概念验证,而且经常冻结或提出一些毫无意义的东西。他们说,如果被赋予对电脑或付款信息的完全访问权,代理可能会意外地擦除电脑驱动器或购买错误的东西。

ChatGPT竞争对手Perplexity AI的首席执行官阿拉文德·斯里尼瓦斯(Aravind Srinivas)表示:“出错的方式有很多。”该公司选择提供人工监督的副驾驶产品。“你必须像对待婴儿一样对待人工智能,像妈妈一样不断地监督它。”

许多关注人工智能伦理的计算机科学家指出,长期存在的人类偏见和潜在的错误信息可能会带来短期危害。虽然有些人看到了未来的贾维斯,但也有人担心《2001太空漫游》中凶残的HAL 9000。

因在神经网络和深度学习方面的研究而被称为“人工智能教父”的计算机科学家约书亚·本吉奥(Yoshua Bengio)敦促谨慎行事。他担心未来先进的技术迭代可能会创造出意想不到的目标,并自行行动。

本吉奥说:“如果没有人来检查每一个行为是否危险,我们最终可能会做出犯罪或可能伤害他人的行为。”他呼吁加强监管。“从现在开始的几年里,这些系统可能比我们更聪明,但这并不意味着它们有同样的道德指南针。”

在网上发布的一项实验中,一位匿名的创造者指示一个名为ChaosGPT的特工成为一个“破坏性的、渴望权力的、操纵性的人工智能”。特工制定了一个五步计划,第一步:“毁灭人类”,第五步:“获得永生”。

不过,它并没有走得太远,似乎消失在了一个研究和存储历史上最致命武器的信息,并计划在Twitter上发帖的兔子洞里。

美国联邦贸易委员会目前正在调查OpenAI对消费者的伤害,该委员会没有直接提到自主代理,但让路透社查阅了此前发表的关于人工智能的深度造假和营销声明的博客。OpenAI首席执行官表示,该公司遵守法律,并将与联邦贸易委员会合作。

“笨得像块石头”

抛开存在的担忧不谈,它的商业潜力可能很大。基础模型是在大量数据(比如来自互联网的文本)上进行训练的,使用的是受生物大脑结构启发的人工神经网络。

据四位了解OpenAI计划的人士透露,OpenAI本身对人工智能代理技术非常感兴趣。其中一位知情人士Garg表示,在完全了解这些问题之前,OpenAI对向市场发布自己的开放式代理持谨慎态度。该公司告诉路透社,在发布新系统之前,它进行了严格的测试,并建立了广泛的安全协议。

OpenAI的最大支持者微软(Microsoft)是瞄准人工智能代理领域的巨头之一,它的“工作副驾驶”(copilot for work)可以起草可靠的电子邮件、报告和演示文稿。

首席执行官萨蒂亚·纳德拉认为,基础模式技术是微软自己的小娜、亚马逊的Alexa、苹果的Siri和谷歌助手等数字助理的一次飞跃,在他看来,这些数字助理都没有达到最初的预期。

“他们全都哑口无言。无论是小娜(Cortana)、Alexa、谷歌助理(Google Assistant)还是Siri,所有这些都行不通,”他在今年2月对英国《金融时报》表示。

亚马逊的一位发言人表示,Alexa已经使用了先进的人工智能技术,并补充说,该公司的团队正在开发新的模型,这将使这款助手更有能力、更有用。苹果拒绝置评。

谷歌表示,它也在不断改进它的助手,它的Duplex技术可以给餐馆打电话预订桌子和确认营业时间。

人工智能专家爱德华·格林芬斯泰特(Edward Grefenstette)上月也加入了谷歌旗下的研究团队谷歌深度思维(Google DeepMind),以“开发能够适应开放式环境的通用代理”。

不过,一些受访者表示,第一批面向消费者的准自主代理可能来自更灵活的初创公司。

投资者蜂拥而至

WVV Capital的杰森·富兰克林(Jason Franklin)表示,他不得不努力投资一家由两位前谷歌大脑工程师创办的人工智能代理公司。今年5月,谷歌风投(Google Ventures)在Cognosys领投了200万美元(约合16.4亿卢比)的种子轮融资,开发提高工作效率的人工智能代理,而今年1月创建代理初创公司Arkifi的Hesam Motlagh表示,他在6月完成了“相当大”的首轮融资。

撰写人工智能通讯的马特·施莱特(Matt Schlicht)表示,至少有100个严肃的项目正在努力将人工智能商业化。

“企业家和投资者对自主代理非常兴奋,”他说。“相比聊天机器人,他们对此更感兴趣。”

©汤森路透2023